‘석학’ 촘스키, NYT 기고서 비판

“기계학습AI, 옳고 그름 구분 못해

인류 출현 이전 인지 수준에 불과

사람이 가진 오류도 사고의 일부”

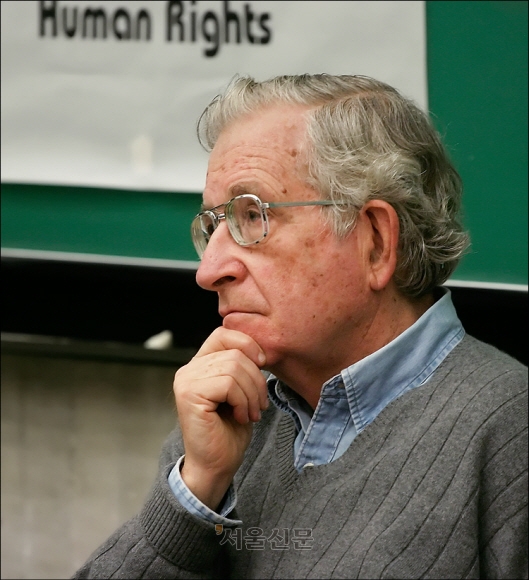

노엄 촘스키

세계적 석학인 노엄 촘스키(95) 미국 애리조나대 교수 겸 매사추세츠공대(MIT) 명예교수가 오픈AI가 일으킨 챗GPT 열풍에 대해 이렇게 말하며 “챗GPT와 같은 프로그램이 계속 AI 분야를 지배한다면 그런 날은 오지 않을 것”이라고 밝혔다.

촘스키 교수는 8일(현지시간) 뉴욕타임스(NYT)에 ‘챗GPT의 거짓 약속’이라는 기고문을 싣고 “근본적으로 결함 있는 AI 언어와 지식 이해를 우리의 기술에 포함해 과학과 윤리를 저하할 것”이라고 비판했다.

우선 그는 챗GPT, 구글의 바드, 마이크로소프트의 시드니 등 기계학습 AI를 언급한 뒤 “처리 속도, 기억력, 통찰력, 예술적 창의성 등에서 기계가 인간의 뇌를 추월한다는 첫 번째 희미한 빛으로 환영받았다”면서도 “인류 출현 이전의, 또는 인간이 아닌 수준의 인지 혁명 단계에 갇혀 있다”고 평가했다. 그는 “인간의 정신은 (기계학습 AI 같은) 육중한 통계 엔진이 아니다. 놀라울 정도로 효율적이고 우아하기까지 한 시스템”이라고 했다.

어린아이가 아주 적은 데이터를 통해 무의식적으로 빠르게 언어를 습득하는 것은 “유전적으로 설치된 타고난 운영체제”라고 했다. 또 “인간에게는 오류가 있다”며 “그러나 이것은 생각하는 것의 일부다. 맞으려면 틀릴 가능성도 있어야 한다”고 강조했다.

촘스키 교수는 “챗GPT 등은 설계상 가능한 것과 불가능한 것을 구분하지 못한다”고 했다. 일례로 ‘지구가 평평하다’와 ‘지구가 둥글다’를 둘 다 학습한 뒤 시간이 흐르면서 확률이 높은 답을 제시할 뿐이라는 것이다.

또 진짜 지능은 인과관계 등을 통해 옳고 그름을 판단하는 윤리적 사고를 할 수 있지만 기계학습 AI는 아직 그렇지 않다고 했다. 그는 “이런 이유로 기계학습 시스템의 예측은 항상 피상적이고 불확실하다. 설령 예측이 맞더라도 사이비 과학에 불과하다”고 지적했다.

워싱턴 이경주 특파원

2023-03-10 25면